¿Nos vemos haciendo Marketing para robots? La verdad es que es un escenario un poco extraño ¿a que si? Pero permitidme haceros una pregunta: ¿Qué es el SEO sino una respuesta, via robot, a las necesidades de los usuarios? Quizá el ejemplo más claro se este

Un video que muestra cómo el humano puede manipular a la máquina para que impacte en el propietario. Es el marketing distribuido, es el marketing indirecto, que llega a ti vía el robot, vía la inteligencia artificial que, en principio, está diseñada para interactuar con su dueño.

Los orígenes de la IA en la búsqueda

Decir que Google inventó la Inteligencia Artificial sería mentir, pero es Google la empresa que, a día de hoy y con la gran tarta de mercado que tiene, nos interesa, porque esto de la inserción de la IA en el buscador no es algo nuevo. Corría el año 2000 cuando Larry page pronunciaba una de sus frases más célebres:

Google would understand exactly what you wanted, and it would give you the right thing. That’s, obviously, artificial intelligence… and that is basically what we work on.

The Gatekeepers Sergey Brin Larry Page and Google de Daniel Alef

“Google entenderá perfectamente qué quieres y te dará exactamente lo que buscas. Esto es, obviamente, inteligencia artificial, y es, básicamente, en lo que estamos trabajando.” Pero aunque en aquellas fechas pudiera sonar a muy lejano, a ciencia ficción, no lo es. Estamos hablando de presente. Estamos hablando de ahora.

La voz, ¿el caballo de Troya?

La interacción con la pantalla nos hace permanecer en un entorno seguro: yo estoy aquí y tú, ordenador, estás detrás de la pantalla, que está quieta, en tu mesa, en tu despacho, en tu habitación y tienes que interactuar conmigo sólo cuando yo te lo ordene. Pero todos sabemos que eso no es así: en el momento que introducimos un usuario en una máquina la máquina se vuelve imprevisible.

Pero no es hasta la entrada de los smartphones en nuestra vida que la interacción hombre-máquina se hace constante y permanente. Desbloqueamos nuestro teléfono móvil (según Phone House) unas 150 veces al día de promedio y el 87% de los usuarios de smartphone acceden a la búsqueda como primer paso ante una necesidad , como nos comentaba Sridhar Ramaswamy, senior Vice President of Ads & Commerce at Google durante el Google Marketing Next de mayo del 2016. Es decir: 9 de cada 10 usuarios buscan con su smartphone ante cualquier problema o inquietud.

La voz, qué importante para nuestra estrategia

Los asistentes personales

Los asistentes con Inteligencia Artificial usan una variedad ingente de fuentes, la mayoría extraída de los rankings de los buscadores y fuentes “de confianza”, (Wikipedia, Google, Alexa, Youtube,… no, facebook no, no sabe buscar) Por eso hay una gran discrepancia entre, por ejemplo, los diferentes resultados que da Google o Alexa, porque beben de diferentes fuentes. El ejemplo más claro está en la discrepancia de horas y minutos que tardan las películas. Es bastante poco probable que encuentres el mismo resultado si están bebiendo de diferentes fuentes creadas por humanos en vez de la fuente original.

La lucha por la interfaz

No es solo keyword research, es una lucha por entender qué busca el usuario. Por eso es importantísimo el rodear a nuestra web de contenido que responda esas necesidades. Y para ello no solo sirve el keword research, como decíamos, necesitamos organizar nuestro contenido en base a qué sabemos de nuestro usuario o cómo sabemos que nuestro usuario nos busca: chats de atención al cliente, call centers,… preguntemos a los que están cara al público qué inquietudes tienen nuestros clientes. Toda esa información nos permite “alimentar a la máquina”

Hasta las tareas que requieren interacción pueden desarrollarse vía voz

Behshad Behzadi (Director de búsqueda conversacional en Google) durante el SMX West de Marzo del 2016 ya lo avisaba

Google is indeed working on bringing voice search capabilities to shopping., a conversational search.

Behshad Behzadi (Director of Conversational Search) SMX West de Marzo del 2016

Y un cambio en la manera de trabajar la interfaz de usuario implica un cambio en la forma de desarrollar e interactuar. La búsqueda por voz puede devolver resultados de voz, o puedes controlar una interfaz vía voz, por lo que las órdenes tienen que ser claras y establecidas (todos pensamos en los GPS de los coches). Pero la interfaz móvil de un buscador que te permite hablarle, directamente, en lenguaje natural, nos plantea un cambio muy interesante.

La conversación con la máquina, según Behsad Behzadi se desarrolla de la siguiente manera:

- Muéstrame flamencos

- Muéstrame flotadores de flamencos (granularización de la búsqueda)

- Muéstrame los de tiendaweb.com

- Echa a la cesta ese dorado

Como veis, es una conversación completamente libre, sin las órdenes estrictas y prediseñadas de otros sistemas. La IA del asistente se basa en ejemplos, ejemplos aprendidos via machine learning, via experiencia de uso, por lo que un uso continuado hace que la IA de tu dispositivo (tu cuenta de Google) cada vez sea mas relevante.

Gracias a lo que el propio usuario le va enseñando con la forma que tiene de hablar, de preguntar y con los datos que día a día va compartiendo

Comenta Behshad Behzadi en esta entrevista en Expansión .

La clave de nuestro asistente es la conversación. Los humanos empleamos un lenguaje natural para comunicarnos y usamos decenas de fórmulas diferentes para efectuar una misma pregunta. Por ejemplo, antes, para buscar el tiempo en París el fin de semana era necesario emplear palabras clave: ‘tiempo, París, fin de semana’. Ahora, es posible decir ‘¿necesitaré chaqueta este fin de semana?’ o ‘¿cómo hará este viernes?’, y el asistente sabrá que estás preguntando por el tiempo y en la ciudad en la que vives.

Así pues, sin duda, estamos ante un cambio bastante importante en la búsqueda por voz

¿Pero tiene tráfico la búsqueda por voz?

Antes, las empresas grandes se merendaban a las pequeñas. Hoy, las que tienen el tráfico, se comen a las grandes. Estamos hablando de que Google maneja, según Danny Sullivan en Search Engine Land 2.000.000.000.000 de búsquedas al año. De estas, el 50% son búsquedas realizadas con dispositivos móviles. Pero lo más relevante es que el 20% de estas búsquedas realizadas en el móvil son búsquedas de voz, según Sundar Pichai en la presentación de Google I/O de 2016.

200 000 000 000 de Busquedas por voz

¿Y viene de hace mucho?

En septiembre del 2014, 1 de cada 10 búsquedas en Baidú se hacían por voz. En junio del 2015 Siri ya manejaba 1.000M de búsquedas por voz a la semana. Y en Mayo del 2015 el 20% de las búsquedas se hacían por voz en Andrid y el 25% en la taskbar de Bing en Microsoft. En 2020, el ingeniero de Baidú Andrew Ng calcula que el 50% de las búsquedas se podrán responder por voz o por imágenes. ¿Será el fin de las SERPs tal y como las conocemos?

El uso de la búsqueda por voz

La verdad es que a los que no estamos acostumbrados a la búsqueda por voz nos resulta extraño el hablarle a un micrófono. Pero no es menos cierto que los más pequeños de la casa hablan a Siri o a Alexa con total naturalidad, ya que se divierten hablando “con la persona” que está detrás de ese Smartphone.

El por qué, el quién y el dónde

- ¿Dónde se usa la búsqueda por voz? La mayoría de las búsquedas se realizan en casa y en solitario. Coincido con Stone Temple en su aseveración de lo curioso que es el impacto en el uso de la presión social. En general, los usuarios se encuentran más cómodos hablándole al dispositivo cuando están solos o no hay nadie escuchando. Después, cuando ven que las contestaciones son “normales” y que pueden sacarle partido pasan a comentarlo en los grupos de amigos.

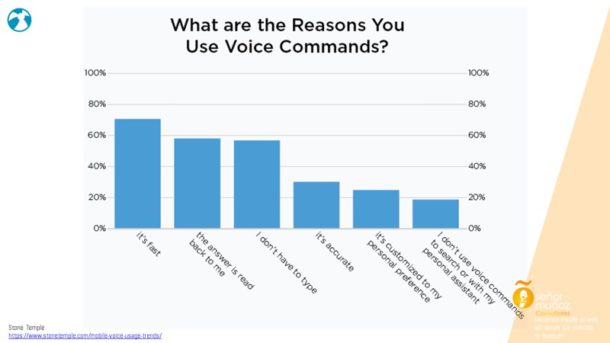

- ¿Por qué se usa la búsqueda por voz? La mayoría lo usa porque es rápido (65%) y porque no tienen que prestar atención a la pantalla, ya que la respuesta es leída por el dispositivo (59%) y, obviamente, ya que el usuario es vago, un 58% lo usa porque no tiene que escribir.

Stone Temple: uso de comandos de voz

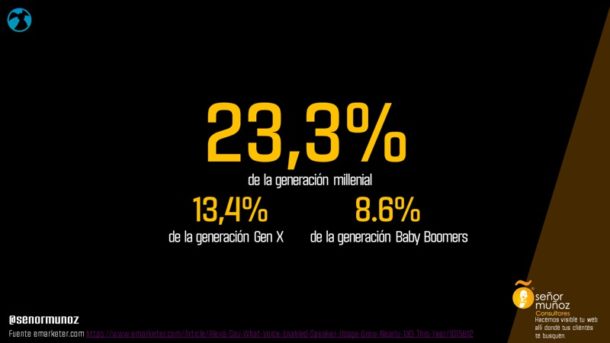

- ¿Quién la usa? Según el estudio de emarketer 1 de cada 4 de la generación millenial, 1 de cada 10 de la generación X y 1 de cada 15 de la generación Baby Boomers ¿Es esto una cosa de la edad? Seguramente sea un cambio en la educación de las personas. Las nuevas generaciones no tienen tanto “pavor” a hablar por la calle, a hablarle a una máquina. Porque nacieron con un Smartphone en las manos (que sus papás les pusimos, por otra parte, para que no molestaran durante la comida o la siesta, por ejemplo).

Porcentaje de uso de la búsqueda por voz por edad. Fuente emarketer

La guerra de los asistentes

Siri (Apple), Cortana (Microsoft), Google Now (Android) o Sherpa luchan por el control de tu móvil, de tu vida, por el control de saber qué buscas, cómo buscas, por qué buscas, cuándo lo buscas y donde lo buscas porque entonces, y solo entonces, podrán mostrarte la publicidad más segmentada posible. Estamos en una lucha por la interfaz de usuario. Y en esta interfaz de usuario dependemos mucho de los móviles. Es, a día de hoy, algo que llevamos siempre o que tenemos en cada casa. En la mayoría de las casas más de uno. ¿Os imagináis cómo sería el mundo si todos esos teléfonos móviles estuvieran escuchándonos todo el tiempo? Bueno, tal vez lo hagan ya…

Los asistentes y las fuentes de las que beben

Casi tan importante como los dispositivos son las fuentes de las que beben para desarrollar sus respuestas. Con un 89% de cuota de mercado de Android (según los datos de statista) es obvio que Android (es decir, Google) tiene una gran ventaja competitiva. Además, Google es el que más cerrado tiene el mercado, ya que muchos de los resultados que devuelven los asistentes vía voz son productos Google (negocios locales, tiempo, hora, hoteles, aviones,… de sus propias cabeceras, aunque empresas como eCartelera se meten en el mundo de las películas o UpToDown en el de las descargas y software, no es menos cierto que son las menos) mientras que sus dos competidores (Alexa y Siri) beben de otras fuentes mucho más diversas (en la línea de negocios locales tira de OpenTable, CitySearch, Yelp, Yahoo! local y Reserve Travel, en el de ticketing de Eventful, StubHub y LiveKick, en el de las películas, Movie tickets y Rotten Tomatoes o en el de las preguntas, de Bing Answers, Wolfram Alpha y Evi)

La personalización de los asistentes personales.

Pero casi tan importante como las fuentes, tenemos tres cuestiones que dan una ventaja muy importante a los asistentes personales: 1) la personalización de los resultados 2) son portables y 3) siempre están conectados.

Estas cuestiones nos colocan frente a esa necesidad perentoria del ser humano actual: siempre conectado. El miedo a quedarse desinformado, ya sea de la actualidad, ya sea de tu nicho de mercado, ya sea de tu círculo de amigos da pábulo a una enfermedad y un tipo de personas: Los FOBO (Fear of being offline).

Drivers de tráfico hacia (usos normales)

Esa personalización y esa portabilidad, así como ese “siempre conectado” nos empuja a no obviar que la mayoría de las búsquedas se van hacia los servicios locales (conocidos en el mercado anglosajón como el brick-and-mortar, es decir, tintorerías, estancos, concesionarios, talleres y restaurantes,…), ecommerce (donde Amazón se lleva la palma) y el consumo de media (blogs, periódicos, con especial preponderancia a los diarios deportivos,…)

Las búsquedas por voz son un tipo de búsqueda informacional que desembocan en respuestas sencillas o muy específicas. Y esa es la manera en la que podemos atacar, como SEOs lo que los usuarios busquen. De nuevo, una de las máximas SEO: responder a las necesidades del buscante.

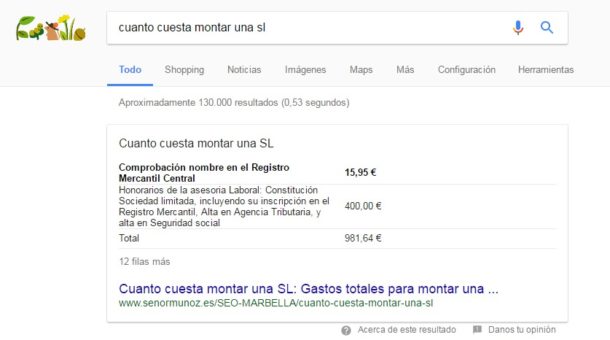

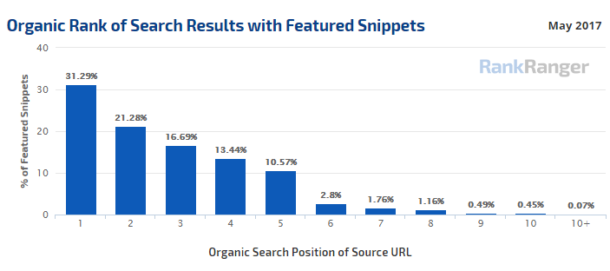

El Ranking Zero

El ranking Zero es cómo se denomina a aquél resultado que está destacado dentro de los resultados de búsqueda con un snippet destacado o, en su término anglosajón “featured snippet”. Se denomina Ranking Zero porque aparece por encima de los 10 resultados tradicionales. Y no es necesario ser el número 1 para que Google decida darte un snippet destacado, como publicaba Tzvi Barish en RankRanger. Si tu resultado está entre el 1 y el 5 Google puede “premiarte” (y veréis más adelante por qué lo pongo entre comillas) con un snippet destacado.

Organic Positions of Featured Snippets. RankRanger

Este Ranking Zero es mucho más relevante en la búsqueda por voz, porque es el contenido que Google leerá al usuario. Así que, como parte de tu estrategia SEO, debes intentar adivinar qué competidores tienen ese featured snippet y por qué lo tienen: ¿Contestan mejor a la pregunta del usuario? ¿Quizá resuelven sus dudas?,…

Pero ¿Qué pasa cuando este Ranking Zero es parcial?

No es raro encontrar un resultado parcial, un resultado que no esté completo. Este resultado incompleto requiere de una interacción del usuario para recabar toda la información. Y si bien algunos usuarios terminarán en la web que produce ese “ranking zero” no es menos cierto que habrá muchos que se queden en el simple discurso del asistente.

Con ejemplos se ve mucho mejor: Si nos quedamos con lo que dice el featured snippet nos quedaríamos en que el erizo es un ser maravilloso que solo come cosas chungas como insectos, invertebrados, gusanos y esas cosas asquerosas. Pero hete aquí que el señor erizo también se zampa ratones, polluelos y los huevos de los pájaros, porque el puto erizo es un devorador nato.

¿Hay una correlación entre los Featured Snippets y las respuestas de voz?

La verdad es que sí. Y tiene sentido porque Google Home y su buscador es el mismo que el buscador normal, así que se alimenta del contenido que este le proporciona. Lo avanzaba John Mu en twitter:

AFAIK the search results from voice queries are the same as normal ones. Should the be different?

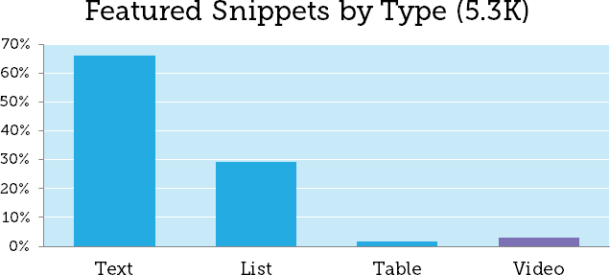

Pero antes ¿Sabéis cuantas búsquedas devuelven un featured snippet? Según Dr. Peter J. Meyers el 71% de las búsquedas por voz que empezaba por preguntas (cuando, donde, por qué, cómo, quién) generaron las mismas respuestas que los featured snippet. Pero este porcentaje se repartía de forma poco equitativa entre listas, texto, resultado directo o video: 66% de texto, 2% tablas, 29% listas y 4% videos

Featured Snippets, those snippets broke down into four types. Dr Peter J Meyers

Entonces ¿me interesa tener un Featured Snippet?

Una web rankea por encima de las demás como único resultado o resultado destacado con información sobre la pregunta realizada. Esta pregunta puede ser simple o compleja en función no de la pregunta en sí, sino de la respuesta que da el asistente: Así, una pregunta del tipo “¿cómo se hace una tortilla de patatas?” dará una información compleja que no cabe en la pantalla y por la cual el usuario deberá ir al sitio, pero una pregunta simple, donde el resultado se da mediante una respuesta corta, el usuario no tendrá ni que entrar en la web (recordemos: el usuario es vago por naturaleza).

Y este resultado tiene un CTR altísimo. Según John E Lincoln en Search Engine Land el pasado 5 de abril del 2017 el resultado destacado tiene un CTR por encima de la media del sitio de 187%.

CTR Snippet destacado. Fuente SEL John E Lincoln

Aunque no todo van a ser buenas noticias como bien destacada Justin Briggs en su tweet donde se vé la gráfica de la caída de tráfico (clics) según Google Search Console de una búsqueda donde su página era número 1 y Google le dio un resultado destacado. Por completar parece que, mientras en España aún (Junio del 2017) podemos ver que el featured snippet no pierde la posición en orgánico, en EEUU la posición en orgánico desaparece y te deja, solamente, en el featured.

What happens when Google gives you an answer box for a SERP you already rank #1 for. #thanksgoogle pic.twitter.com/UTfpRtiZ7Q

— Justin Briggs (@justinrbriggs) 19 de junio de 2017

La lucha por la Inteligencia Artificial

Decía Jose Miguel Moreno en abril del 2015 en esta misma página web

Desde Noviembre del 2008 google ha almacenado: el país y el idioma, los datos de audio, lo que el sistema considera que se ha dicho, el ID de tu cuenta de google y la geo-localización.

Jose Miguel Moreno, La búsqueda por voz. Abril del 2015

La conversión de los datos de audio en texto escrito resulta bastante compleja porque, como es obvio, cada persona habla de forma diferente. Incluso entre los habitantes del mismo país pueden variar múltiples factores como:

- La velocidad: además de hablar rápido o lento, normalmente acabamos las frases más rápido de lo que las empezamos.

- El acento, el tonoy la entonación.

- Su naturalidade

Incluso la forma de hablar de una misma persona evoluciona con el tiempo.

No es, pues, tarea fácil el diseñar un solo modelo de reconocimiento de voz que funcione para todos los hablantes del mundo. Menos aún en lenguas donde la correspondencia entre el texto escrito y su equivalente fonético es poca (inglés) o ninguna (mandarín). Por ello, y con la finalidad de mejorar sus servicios de síntesis del habla, Google mantiene almacenados en sus servidores los datos de audio.

Los actores dentro de la búsqueda por voz

Según Wikipedia, la síntesis del habla es la producción artificial (no pregrabada) de habla humana. Este proceso consta de dos partes: back-end y front-end (sí, como tu CMS).

El front-end preprocesa los textos y asigna una transcripción fonética a cada palabra, además de dividir y marcar el texto en varias unidades prosódicas como frases y oraciones.

El back-end, más conocido como sintetizador, toma la representación lingüística simbólica y la convierte en sonido.

Cuando realizamos una búsqueda por voz en Google desde cualquier tipo de dispositivo, actúa el front-end de la síntesis de voz para convertir lo que hemos dicho en texto escrito. Si os fijáis, pasa como con el texto predictivo: mientras hablas, a la vez que escribe, va corrigiéndose ese texto escrito. Incluso hay veces en las que te corrige automáticamente (por ejemplo, cuando dices “comprar zapato” Google escribe “comprar zapatos”). Y en muchos casos, inmediatamente después actúa el back-end para leernos en voz alta el resultado que Google considera más relevantes.

Intencion + Datos + Aprendizaje

Este trío es un todo, donde la intención de la búsqueda junto a los datos de tu IA mas el aprendizaje que esta IA pueda tener se combinan en la mejora de esta Inteligencia.

Un ejemplo: Google Photos. Si os fijáis es muy sencillo, dentro de una carpeta de este software hacer búsquedas tales como: caras, arcoíris, atardeceres, coches,… Y parece sencillo pero os aseguro que no lo es gracias al machine learning.

La guerra de los dispositivos: Amazon Echo vs Google Home

Amazon echo

Amazon echo es el dispositivo estrella de Amazon. Y uno de los dispositivos que pueden cambiar el sistema de juego. Amazon tiene su propio buscador interno y Alexa se llama su sistema de voz. Alexa tiene su propia API y es esta ASK (Alexa Skills Kit), que, a día de hoy según el gigante americano tiene más de 10.000 skills, cuenta con programas desarrollados por Starbucks, Uber o bancos como Capital One.

El servicio de Amazon Echo se “vende fácil”: “Customers don’t need to use their hands; all they have to do is ask Alexa.” ¿Por qué? Porque es más sencillo usar la voz que escribir. Cuando hay una búsqueda muy compleja o una orden de por medio, el servicio es tan sencillo como decirle al dispositivo qué quieres. Pero es que Amazon Echo puede interactuar de forma diferente con diferentes usuarios dependiendo de donde estén o cómo quieran organizar su gestión: encender las luces de tu casa, preguntar a una web, jugar al Jeopardy,…

Con esta publicidad Amazón Echo llegó a la ¿friolera? cifra de 5.200.000 unidades del dispositivo en el 2016. Bueno, quizá no sea mucho, pero lo que es seguro es que tienes 5.200.000 dispositivos que van a hacer su compra en la tienda de Amazon. Y eso es una ventaja.

¿Para qué se usa Amazon echo?

Como somos un poco gilipollas, le hemos pedido matrimonio a Alexa, la asistente de Amazon, mas de 250.000 veces en todo el 2016. Según el post de Felix Richter casi un 85% de sus usuarios le ordenan una cuenta atrás, similar número a los que le piden una canción. Un 66% para leer las noticias y ya, con menos de un 50% para controlar las luces de la casa o de un dispositivo o para añadir productos a la lista de la compra.

Google home

Surgió en el 2016 y está ya funcionando en EEUU, vendiéndose en todo el año pasado 1.300.000 de unidades. Google home sigue la filosofía del Google now, la interfaz via voz de android y cuenta con todos los desarrollos de Google en desktop: reloj, calculadora, calendario, información de vuelos,… Es decir, es un google now metido en un hardware que está en tu casa/oficina escuchándote siempre.

Poniendo en perspectiva los números de Home y Echo la verdad es que no son muy halagüeños, ya que, solo en USA, se han vendido 207.000.000 de dispositivos Android en el 2016. Y si nos fijamos en España, el mercado de dispositivos se decanta claramente a favor de Google now (porque 9 de cada 10 dispositivos tienen sistema operativo Android). Es, pues, una lucha desigual entre los sistemas operativos y los dispositivos de búsqueda y, por ende, de los buscadores (Android usa Google, mientras que Siri y Alexa usan bing, de Microsoft) Por eso el mercado está en una lucha desigual.

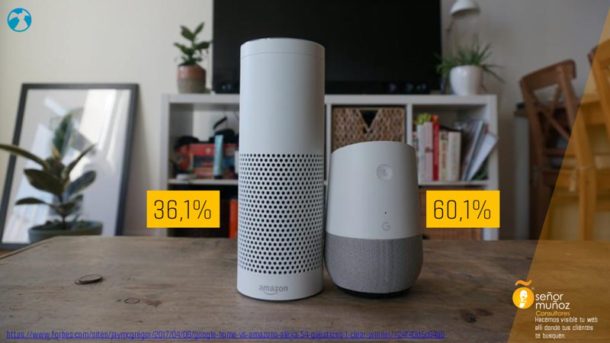

¿Quién acierta más: amazon echo o google now?

Según el estudio (hilarante estudio) publicado por Jay McGregor en Forbes, hay un claro ganador: Google Now. Estamos hablando de aciertos por encima del 60% contra un acierto que sobrepasa por poco el 36% de Amazon Echo.

¿Quien acierta mas Google Home o Amazon Echo? Fuente Jay McGregor estudio

Problemas de los asistentes personales

Lo que si entra en este post es el debate de dos grandes problemas que tienen los asistentes personales: 1) los asistentes personales no responden a un usuarios, sino a aquel que le habla. Esto puede llevar a problemas en el caso del uso de, por ejemplo, el anuncio que hemos puesto arriba del todo, donde el gadget responde al anuncio de la televisión, presentando un problema grave de identificación vs actuación a una orden. Y 2) ¿Qué pasa cuando el resultado único está equivocado o tergiversado/manipulado por Google? Al ser el “cerebro” dependiente de la empresa, si esta decide cambiar su estrategia, o incluir (por ejemplo) resultados patrocinados en sus contenidos ¿Cómo, como usuarios, podemos defendernos ante esto?.

Y, cómo diría Sergio Simarro en este video de Sistrix: ¿Qué pasará cuando ese único resultado sea de pago? El problema es que Google ya lo ha probado y ya nos ha metido un anuncio: Con la salida de la Bella y la Bestia nos “coló” un anuncio el pasado 16 de Marzo del 2017.

¿Habrá cambios en el SEO? ¿Estás preparado para la búsqueda por voz?

Se espera un 128,9% de incremento del mercado de asistentes en el año 2017 según emarketer.com y Purna Virji (Bing), en The Inbounder 2017 avisaba de un porcentaje bastante llamativo que había sacado Gartner: el 30% de las de búsquedas en web se harán en dispositivos sin pantalla, como pilló Ricardo Tayar en la foto de su charla.

This is something to think about. A new type of digital experience to design. #TheInbounder pic of @purnavirji slide pic.twitter.com/ROIr8DyDio

— Ricardo Tayar (@rtayar) 22 de mayo de 2017

Además, los featured Snippets como bien recoge Stone Temple en su estudio de 855.000 queries, están creciendo muchísimo, pasando de ser solo un 22% en Diciembre de 2014 a ser un 41% en Enero del 2016, por lo que se espera que este año 2017 estos featured snippets, siguiendo esa evolución, se coloquen alrededor del 50%.

Realmente el concepto SEO es el mismo, aunque eso da para otro post. Más adelante (en otro posts) hablaremos de ello.

Vamos terminado, que esto se me ha hecho bola ya hace unos párrafos. Antes, un poco de futurología

Dos cambios de paradigma:

- Estamos hablando de diseñar para la voz, no para el ojo.

- Estamos hablando del fin de los 10 resultados. Del cambio en cómo encontramos información.

Ahora, háblale a la máquina y aliméntala.

[…] Ranking Zero Featured Snippets […]